Söylemediğiniz sözleri söyleyeceksiniz! Deepfake teknolojisi dünya genelinde hızla endişe yaratmaya devam ediyor

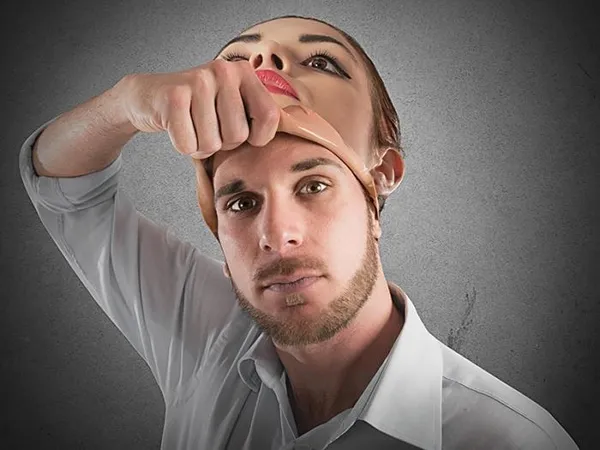

İnternette hızla yayılmaya başlayan "Deepfake" adı verilen sahte video montaj tekniği dünya genelinde endişe yaratıyor. Mevcut bir görüntü veya videoda yer alan bir kişinin, yapay sinir ağlarını kullanarak bir başka kişinin görüntüsü ile değiştirildiği bir medya türü olarak tanımlanan “deepfake” büyük sorunların yaşanması endişesini doğuruyor. Ünlü isimlerin konuşturulduğu ve canlandırıldığı videoları gerçeğinden ayırmak imkansız. İşte "Deepfake" sahtekarlığı...

Birkaç yıl önce Washington Üniversitesi'nden bir araştırma ekibinin eski ABD Başkanı Barack Obama'nın yüzünün dijital ortamda taklit edildiği bir videoyla gündeme gelen "deepfake" teknolojisi, geçtiğimiz günlerde bir TikTok kullanıcısının ünlü oyuncu Tom Cruise'un yüzünü kopyaladığı videoları yayınlamasıyla yeniden konuşulmaya başladı.

(TOM CRUISE VE DEEPFAKE)

SON DERECE GERÇEKÇİ

Mevcut bir görüntü veya videoda yer alan bir kişinin, yapay sinir ağları kullanarak bir başka kişinin görüntüsü ile değiştirildiği bir medya türü olarak tanımlanan "deepfake" teknolojisinin, Cruise videolarıyla birlikte son derece gerçekçi bir noktaya geldiği görüldü. Yapay zekâ yardımıyla bir kişinin görüntüsünün ve sesinin dijital ortamda oluşturulmasına imkân veren "deepfake" teknolojisi sunabileceği imkânların yanında bazı endişeleri de beraberinde getiriyor.

EĞİTİMDE KULLANILIYOR

Deepfake teknolojisinin belirli işkollarında maliyeti düşürebileceği ve erişilebilirliği arttırabileceği öngörülüyor. Londra merkezli Synthesia firması bu teknolojiyi, şirket içi eğitim videolarında kullanılmak üzere pazarlıyor. California Üniversitesi ise Soykırım Vakfı ile birlikte soykırımdan kurtulanları bu teknolojiyi ve tanık kayıtlarını kullanarak ziyaretçilerle bir araya getiriyor. Teknolojinin ilerleyen dönemde göstereceği gelişmeye bağlı olarak insanların kaybettikleri aile yakınları ile dijital ortamda konuşabilmesinin de mümkün olduğu düşünülüyor.

ENDİŞELER DE VAR

Öte yandan bu çığır açıcı teknolojinin ortaya çıkardığı soru işaretleri de mevcut. Özellikle politikacıların ve ünlülerin hiç söylemedikleri ya da yapmadıkları şeylerin taklit edilebilmesi ihtimali, büyük sorunların yaşanması endişesini doğuruyor.

O KADAR KOLAY DEĞİL

Deepfake videolarının yaratıcısı Chris Ume, bu tür videoların sahtekarlık için kullanılmasının o kadar kolay olmadığını belirtti. Örneğin Tom Cruise videolarında oyuncunun taklidini yapma konusunda son derece yetenekli ve ona hayli benzeyen bir 'taklitçisini' kullanmasının yanında yalnızca deepfake algoritmasını değil pek çok görsel efekt programını bir arada kullandığını açıkladı. Ume, videoyu iki ayda yaptığını söyledi.

GÜNÜN MANŞETLERİ İÇİN TIKLAYIN

GÜNÜN MANŞETLERİ İÇİN TIKLAYIN